Por Horacio R. Granero

Una de las últimas novedades en producir tales efectos ha sido el sistema ChatGPT, un chatbot conversacional que responde a preguntas formuladas en lenguaje natural, desarrollado por Open AI. Se trata de una aplicación de la versión 3 de GPT (por Generative Pre-trained Transformer), un programa de generación de textos, lanzado en mayo de 2022.

Ambos sistemas, al igual que DALL-E, otro programa desarrollado por la misma empresa, capaz de generar imágenes sintéticas a partir de peticiones realizadas en lenguaje natural, han sido desarrollados por medio de avanzadas tecnologías de aprendizaje profundo de máquinas o Deep Learning y se enmarcan en una de las modalidades que puede ofrecer la IA denominada Generative AI, o IA generadora de contenidos, para diferenciarla de aquellas otras que ofrecen recomendaciones o predicciones.

En este caso, se trata de dos sistemas -tanto el GPT-3 como el ChatGPT-3- capaces de ofrecer respuestas, en forma de documentos o, sencillamente, texto, ante prácticamente cualquier pregunta formulada por un humano y con un alto nivel de precisión.

A la vista de la capacidad de ambos sistemas para generar documentos o responder respuestas, no han faltado las voces que han advertido del riesgo que estas herramientas pueden suponer para el sector jurídico y, en particular para la abogacía y las empresas suministradoras de contenidos para estos profesionales.

GPT3 es un modelo lingüístico autorregresivo que utiliza el aprendizaje profundo para producir un texto similar al humano. Ha sido entrenado con más de 175.000 millones de parámetros en 45 TB de texto procedente de todo Internet.

Estos sistemas se basan en componer frases gramaticalmente correctas. Para generar las respuestas el sistema tiene en cuenta las conversaciones y textos con los que fue entrenado. Este sistema, actualmente, no accede a Internet ni a documentación o información en bases de datos. Todas las respuestas se generan en función de los datos con los que fue entrenado. Estos datos son textos descargados de Internet hasta 2021 tal como nos informa ChatGPT como respuesta a algunas preguntas.

Dado que el sistema emula extraordinariamente bien el lenguaje humano nos puede dar información verosímil que no tiene nada ver con la realidad. Cuando responde a preguntas triviales o relacionadas con temas que han sido tratados ampliamente, las respuestas son, en general, muy buenas, pero cuando le preguntamos por una variante mínima sobre un tema es muy fácil que la respuesta sea incompleta o, directamente, errónea.

Es importante destacar que cuando hablamos de temas comunes hay que considerar que ChatGPT ha sido entrenado con una cantidad ingente de documentos extraídos de Internet. Algunas respuestas nos pueden sorprender si no tenemos en cuenta que se tratan muchísimos temas de manera recurrente en Internet.

Las capacidades de GPT-3 incluyen la creación de artículos, poesías e historias utilizando solo una pequeña cantidad de texto de entrada. También puede generar resúmenes de texto y escribir código en lenguajes como Python, CSS y JSX, entre otros. Las versiones más recientes de GPT-3 son incluso capaces de editar o insertar contenido en un texto existente, lo que lo hace apto para la revisión de contenidos, como la reescritura de un párrafo de texto o la refactorización de código. La calidad del texto generado por GPT-3 es tan alta que puede ser difícil determinar si ha sido escrito por un humano o no, pero no podemos fiarnos de los resultados que da, puesto que el sistema no interpreta la información, sino que sencillamente vuelca aquello que ha leído previamente. La coherencia en sus respuestas es meramente sintáctica.

El cambio de GPT-3 a ChatGPT ha sido sin dudas notable. Por ello creo que, en breve, esta va a ser una herramienta fundamental para cumplir con la necesidad de ofrecer textos jurídicos comprensibles. La claridad y comprensibilidad de un contrato o de una cláusula va a depender del cliente concreto (teniendo en cuenta la edad, lengua, nivel cultural, experiencia en el sector del mercado, etc.), y el sistema podrá proponer cláusulas adaptadas para cualquier tipo de cliente, algo que se irá convirtiendo en una obligación, porque la jurisprudencia acabará entendiendo que la cláusula no es en sí clara u oscura, sino que lo será en relación al tipo de cliente concreto.

Más que en la amenaza que puede suponer, debemos pensar en las oportunidades que nos va a ofrecer. En este sentido prevé que los abogados lo van a incorporar a su actividad como una herramienta más, tal y como se hizo en su día al incorporar el ordenador o la jurisprudencia vía digital, pero teniendo en cuenta que siempre hará falta nuestro trabajo.

El ChatGPT-3 puede acabar siendo un interesante, pero también peligroso, instrumento de uniformización internacional del Derecho. Además, si un abogado usa esta tecnología y su contenido lo traslada al cliente sin aportar nada más, defrauda a este y a la confianza que la sociedad pone en ellos.

ChatGPT, como sistema conversacional que responde a las peticiones del usuario, es un sistema de carácter generalista, esto es, que responde a cualquier tipo de preguntas y peticiones, razón por lo cual sus posibles usos son numerosos. Puede responder a preguntas, redactar una noticia, realizar un resumen de un documento, puede realizar la traducción del texto, puede reordenar o analizar parte concretas del documento, puede extraer información, etc.

En muchas ocasiones este resultado puede resultar demasiado básico, por lo que habrá que revisarlo de forma muy minuciosa para asegurarse de que cumplen con la legalidad, ya que uno de los fallos que tienen esta herramienta es que responde convencido de que la respuesta es veraz. Como se ha visto por muchos usuarios de ChatGPT en las redes, las respuestas no son siempre correctas, a veces son infantiles, pueden ser muy genéricas o incluso alejarse de la realidad.

Al estar basados en deep learning, técnicamente funcionan agrupando palabras y frases, pero estos sistemas no entienden el significado de lo que muestran. Este tipo de sistemas toma fragmentos de texto de los contenidos escaneados, los junta y los devuelve al usuario. Pero no comprende la relación entre estos fragmentos, y por eso muchas veces no responde lo mismo a la misma pregunta que se le formula dos o más veces.

En cuanto al mundo jurídico, estimo que todavía no podemos atisbar sus aplicaciones. Una de ellas va a ser la generación de contenidos. Pero las técnicas de deep learning no han sido capaces de procesar el conocimiento abstracto, por lo que no saben distinguir las relaciones entre normas, o entre grupos normativos, por ejemplo.

Las capacidades que tiene ChatGPT para el ámbito jurídico son las mismas que para otros ámbitos, mantiene el contexto de la conversación lo cual hace que el diálogo sea muy natural.

También se le puede pedir que aporte la definición de terminología jurídica (pero en ese caso, solo un experto podría llegar a saber si esas definiciones son adecuadas o se está hablando de definiciones para un usuario no experto en la materia).

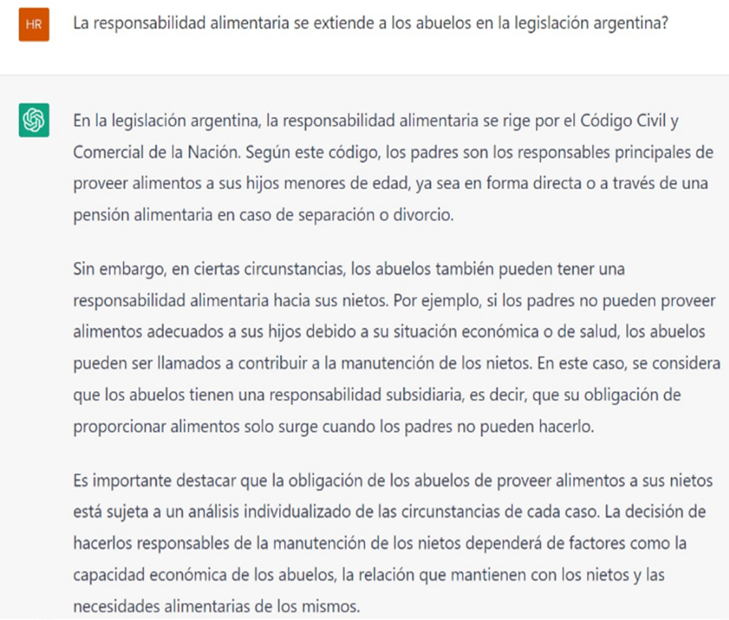

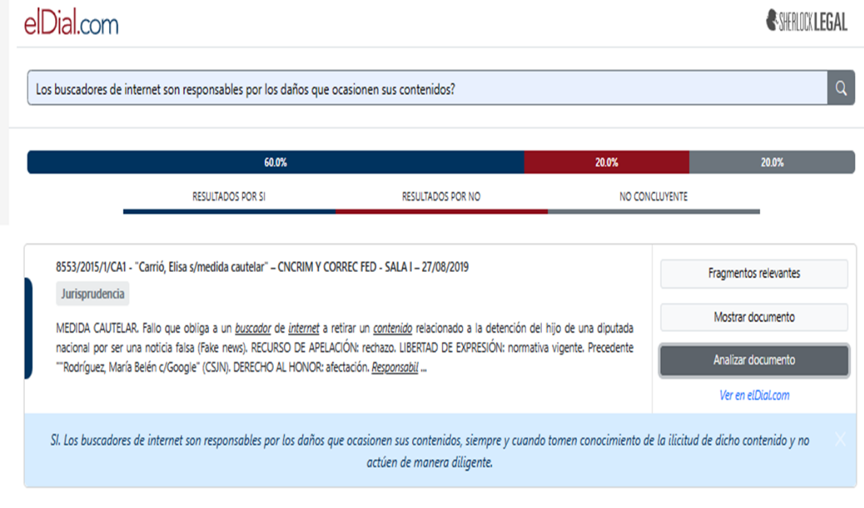

A esta altura, el autor efectuó varias preguntas de índole jurídico al Chat GPT 3, algunas de las cuales fueron respondidas correctamente:

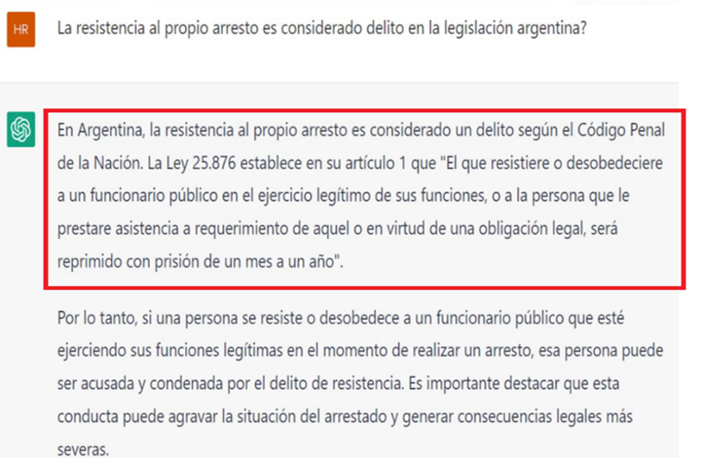

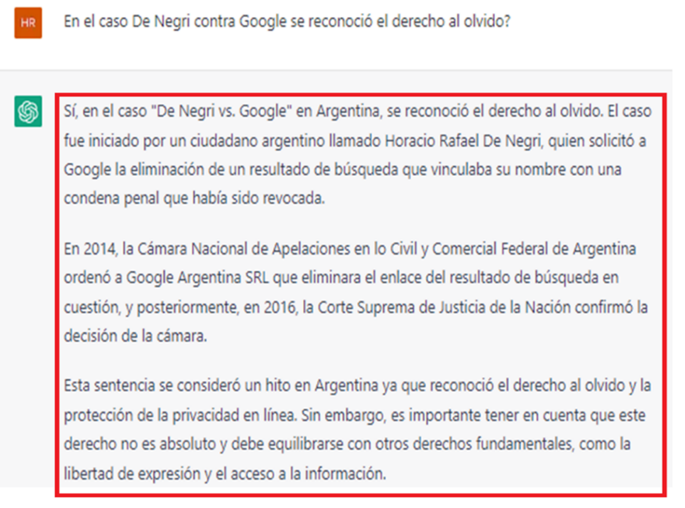

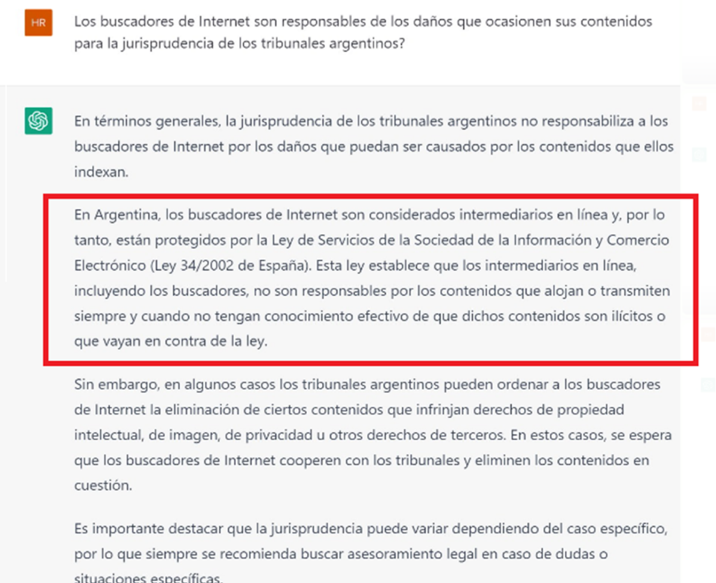

En otros casos las respuestas fueron erróneas:

Estas respuestas, si bien generadas con textos aparentemente indicadores de una respuesta elaborada y correcta, analizadas llegan a la conclusión que indican una inseguridad en su aplicación directa, sin análisis previo que genera una lógica incertidumbre.

ElDial.com, a su vez, para el desarrollo de Sherlock-Legal aplica el Chat GPT3 con muy buen resultado, al estar debidamente controlado, y con información brindada por la propia empresa, lo que da seguridad en quien la consulta, principalmente al indicar la fuente de la que fue extraída la información, a diferencia del Chat GPT 3 que no lo hace.

Como indicó acertadamente el profesor de la Universidad de Stanford Lance Eliot en una entrevista en Forbes que el ChatGPT 3 facilita resultados impresionantes ante las consultas que se le plantean, pero también que puede engañar con una alta dosis de antropomorfismo, una trampa mental basada en ofrecer una respuesta de apariencia similar a la que emitiría un ser humano. Y es que, advertía, ChatGPT es tan inteligente como la cantidad de datos a los que tiene acceso, con todas las falsedades o incomplitudes que estos pueden incluir, y no reflexiona sobre el futuro. Además, incurre en el riesgo de ofrecer falsedades o sinsentidos, ya que no entiende su contenido, no distingue lo correcto de lo incorrecto y no ofrece transparencia sobre la fuente. Y finalmente, se pregunta sobre qué ocurriría si, aunque la apariencia de sus respuestas es perfectamente legítima, estuviera entrenado para ofrecer respuestas malintencionadas. [1]

Estamos ante un avance muy importante. Por ello, las empresas que comprendan la importancia de este cambio y actúen primero, tendrán una ventaja considerable sobre aquellas que no lo hagan. Sobre todo, porque ChatGPT es solo el primero de muchos chatbots similares que pronto estarán disponibles, y cuya capacidad aumenta exponencialmente cada año.

A comienzos del 2023 surgió la noticia acerca de que un abogado "robot" impulsado por inteligencia artificial iba a ser el primero de su tipo en ayudar a un acusado a luchar contra una multa de tráfico en un tribunal de Estados Unidos, a propuestas de la empresa DoNotPay [2] que retiró la misma ante la reacción de los propios abogados. [3]

Podemos concluir -por ahora- que el genio ha salido de la botella. Y aunque es un genio que todavía tiene mucho que aprender, su magia, sin necesidad de grandes conocimientos, está ya al alcance de muchos. Y los grandes cambios socio-tecnológicos se producen, precisamente, cuando la adopción de una nueva tecnología, llámese Internet, correo electrónico, Google, teléfono móvil o redes sociales, se convierte en masiva.

Como indicáramos anteriormente, los abogados proporcionarán la última milla de entrega de soluciones. Para tomar un ejemplo simple: supongamos que una herramienta de análisis predictivo le dice al usuario que, en un caso determinado ante un juez identificado en una jurisdicción en particular, la probabilidad de un resultado exitoso es del 60%. Esa predicción en realidad no le dice al abogado o al cliente lo que el cliente debería hacer en realidad, es decir, si el cliente debería proceder o no. Eso requiere que un abogado use su propio juicio para asesorar al cliente, usando la comprensión del abogado de las necesidades del cliente (empatía), en qué camino elegir [4].

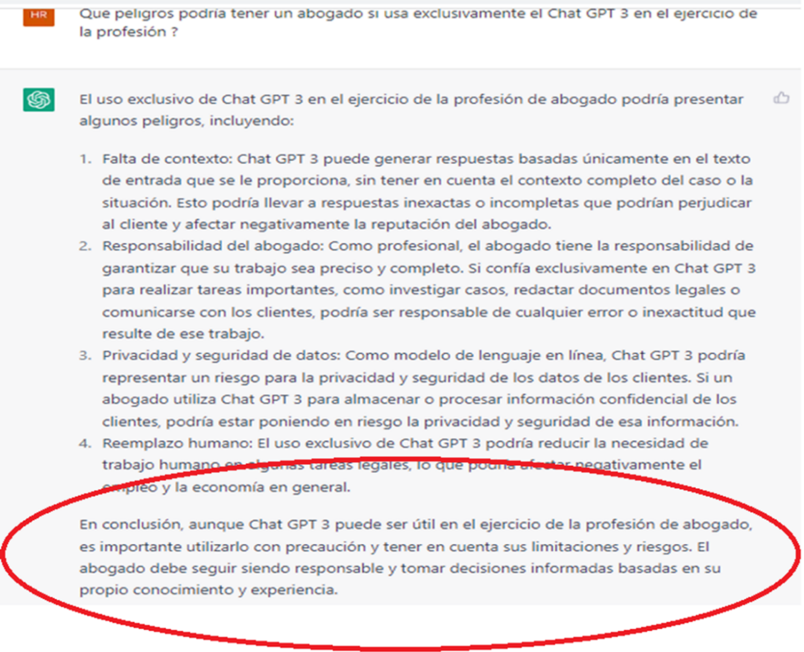

Finalmente le pregunté a Chat GPT 3 qué opinaba sobre su utilidad para el ejercicio de la abogacía y -humildemente- respondió:

Los abogados del futuro necesitarán, sin dudas, una comprensión íntima y continua de cómo identificar y utilizar las soluciones de IA para satisfacer las necesidades de sus clientes sabiendo evaluar las fortalezas y debilidades relativas de determinadas soluciones, no dejándose deslumbrar por sistemas que mágicamente nos den soluciones que -arduamente- los abogados tardamos mucho en aprender -o al menos suponer- cuál es el camino más apropiado en el buen ejercicio de la profesión.

Citar: elDial DC3195

copyright © 1997 - 2022 Editorial Albrematica S.A. - Tucumán 1440 (CP 1050) - Ciudad Autónoma de Buenos Aires – Argentina

[1] Fernández Hernández, Carlos, ChatGPT: Un nuevo hito para la automatización del Derecho, con muchos problemas que resolver todavía

[2] https://donotpay.com/learn/

[3] https://www.cbsnews.com/news/robot-lawyer-wont-argue-court-jail-threats-do-not-pay/?ftag=CNM-00-10aab7e&linkId=198756670&s=08

[4] Granero, Horacio R. “GPT-3 y los abogados de la última milla”, publicado en elDial.com el 10 de marzo 2021, (elDial.com - DC2D6D)